Machine을 이용 후 CUDA가 초기화가 되지 않거나, 잔여 메모리가 nvidia-smi 할 때 GPU에 남아 있는 현상이 가끔 일어나는데,

아래와 같이 python으로 하나 짜둔 뒤 실행해보면 처리가 된다.

initialized_machine.py

# status initialize

import os

os.environ['CUDA_VISIBLE_DEVICES'] = '1' // 초기화할 GPU number

# out of memory

import tensorflow as tf

with tf.Graph().as_default():

gpu_options = tf.GPUOptions(allow_growth=True)

'딥러닝 > CUDA' 카테고리의 다른 글

| cuda 10.0, 9.0 가장 간단하게 설치 (0) | 2019.10.07 |

|---|---|

| nvcc --Version 업데이트 및 torch, pytorch 설치시 nvcc 오류 (0) | 2017.09.28 |

| CUDA 8.0, 7.5, 6.0 등 예전 버전 다운 (0) | 2017.09.28 |

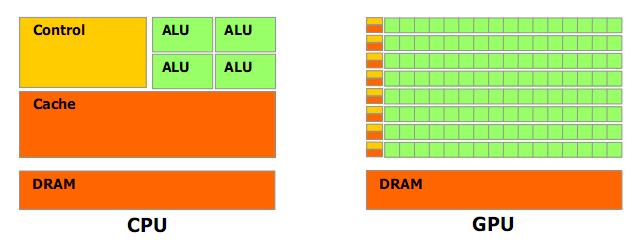

| CUDA (쿠다) 란, 왜 사용하는 것인가. (0) | 2017.03.14 |

| CUDA 란? (0) | 2017.03.14 |